B - Codage de l’image

Un capteur CCD (Charge-Coupled Device) est composé de photosites qui transforment la lumière en signaux électriques. Chaque photosite est équipé d'un filtre coloré (rouge, vert ou bleu), reproduisant la sensibilité chromatique de l’œil humain. Ces filtres permettent au capteur d'enregistrer séparément les trois couleurs primaires.

Le signal électrique généré est ensuite converti en valeurs numériques par un convertisseur analogique-numérique (CAN). En photographie standard, chaque couleur est codée sur un octet (0 à 255), permettant des millions de combinaisons. Des appareils plus performants utilisent une quantification supérieure (12 ou 16 bits) pour une précision accrue.

Décomposition d'une image en pixels. Prise de vue macro d'un écran LCD montrant les éléments rouges, verts et bleus, avec zooms successifs.

Une image numérique est une mosaïque de pixels (picture elements), chacun représenté par trois composantes de couleur : Rouge, Vert et Bleu (RVB). Ce système à trois couleurs utilise la synthèse additive des couleurs. Plusieurs caractéristiques techniques définissent une image numérique :

Définition : Nombre total de pixels constituant l'image (largeur × hauteur).

Exemple : Une image de 1920×1080 pixels a une définition de 2,1 mégapixels (Full HD).

Résolution : Nombre de pixels par unité de longueur (généralement en ppp, pixels par pouce pour les écrans ou points par pouce pour l'impression).

Exemple : La règle d'impression basique est de produire des images en environ 300 DPI pour l'impression.

Profondeur de couleur : Nombre de bits utilisés pour coder la couleur d’un pixel.

Exemple : La plupart des images utilisent 1 octet par canal, soit une profondeur de 24 bits par pixels.

Poids : Nombre de bits nécessaires pour stocker l'image (définition × profondeur).

Exemple : Une image de 1920×1080 pixels de profondeur 24 bits pèse 49,8 millions de bits, soit 6,2 Mo.

Attention : Photosite ≠ Pixel

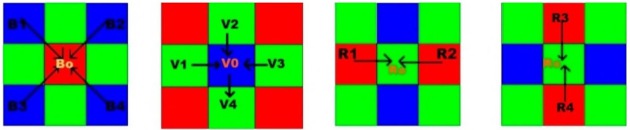

Un photosite ne correspond pas à un pixel car il ne contient l'information que d'une seule couleur (Rouge ou Verte ou Bleue) alors qu'un pixel est codé avec trois valeurs. Le processeur d'image traite les données des photosites pour compléter l'image. En effet, pour chaque photosite, deux canaux colorés sont manquants. Une des techniques utilisées est de calculer la moyenne des valeurs obtenues par les photosites adjacents pour extrapoler les valeurs des deux canaux manquants.

En utilisant les informations des photosites rouges et bleus à proximité d'un photosite vert, le processeur compose un pixel, avec ses trois couleurs. L'image brute ainsi obtenue en sortie du capteur est souvent au format RAW.

En lumière faible, il est souvent nécessaire d'utiliser plus de photosites pour recomposer un seul pixel ce qui conduit à une perte de définition de l'image.